Unmittelbar nach DeepSeek hat auch der chinesische Online-Händler Alibaba eine KI präsentiert, die besser sein soll als ChatGPT. Doch was genau ist Qwen 2.5 und wie funktioniert das Sprachmodell?

Nur wenige Tage nachdem das chinesische Unternehmen DeepSeek die KI-Branche in Aufruhr versetzt hat, sorgt die nächste China-KI für Schlagzeilen. Denn auch Online-Händler und Amazon-Konkurrent Alibaba hat ein Sprachmodell präsentiert, das besser sein soll als ChatGPT – und obendrein auch DeepSeek.

Alibaba-KI: Was ist Qwen 2.5?

Strenggenommen hat Alibaba keine komplett neue KI entwickelt, sondern eine neue Version seines Modells „Qwen“. Unternehmensangaben zufolge soll das Sprachmodell Qwen 2.5 die Leistungen von DeepSeek, ChatGPT und Google Claude fast durchweg übertreffen. Lediglich der Google-Chatbot Gemini könne halbwegs mithalten.

Bei Qwen 2.5 handelt es sich um ein sogenanntes multimodales Sprachmodell. Heißt konkret: Die KI kann verschiedene Modalitäten wie Texte, Bilder und Videos verarbeiten und ausgeben. Wie DeepSeek basiert die Alibaba-KI auf einem quelloffenen Open Source-Ansatz. Der Quelltext der Software ist öffentlich zugänglich und kann von Dritten eingesehen, geändert und genutzt werden.

Denn: Open Source-Software ist unter Einhaltung bestimmter Lizenzbedingungen in der Regel kostenlos nutzbar. Der quelloffene Ansatz ermöglicht es, die angegebenen Leistungswerte von Qwen 2.5 in Form von Leistungstests (Benchmarks) zu imitieren.

Wenn Alibaba seine KI nicht als Open Source-Software veröffentlicht hätte, gäbe es deutlich mehr Zweifel an ihrer Leistung. Gleiches gilt für das Sprachmodell von DeepSeek.

Wie funktioniert das Sprachmodell?

Alibaba bietet seine KI-Modell Qwen 2.5 als Serien an. Es gibt verschiedene Versionen mit einer unterschiedlichen Anzahl an Parametern. Unternehmensangaben zufolge reichen sie von drei Milliarden über sieben Milliarden bis hin zu 72 Milliarden Elementen. Diese KI-Parameter gehen aus den Trainingsdaten eines Modells hervor und sind einstellbar.

Die Elemente entscheiden darüber, wie eine KI funktioniert. Die Anzahl der Parameter hat jedoch keinen direkten Einfluss auf die allgemeine Qualität eines Sprachmodells. Vielmehr decken Anzahl, Qualität und Verknüpfung unterschiedliche Leistungen ab. Bedeutet: Alibaba hat drei Qwen-Versionen veröffentlicht, die unterschiedliche Aufgabenbereiche abdecken.

Das Unternehmen bietet mit Qwen 2.5-VL beispielsweise ein Modell an, das vor allem auf ein visuelles Verständnis von Texten, Tabellen, Diagrammen und Grafiken zugeschnitten wurde. Es soll Videos verstehen können, die länger als eine Stunde sind und dazu Fragen beantworten.

Das Modell Qwen 2.5-1M soll sich wiederum dadurch auszeichnen, besonders lange Kontexteingaben zu verarbeiten und damit lange Konversationen ermöglichen. Laut Alibaba könne es bis zu eine Million Token verarbeiten. Das sind die kleinsten Dateneinheiten, die ein KI-Modell für die Verarbeitung von Eingaben und Ausgabe von Inhalten nutzt.

Zum Vergleich: Die Standardversion von ChatGPT 40 verarbeitet rund 8.000 Token im Kontext. Die Anzahl der Token kann zwar die Leistung eines KI-Modells verbessern, allerdings ist der praktische Nutzen sehr großer Tokenfenster umstritten. Die Version Qwen 2.5-VL-72B-Instruct bezeichnet Alibaba derweil als sein „Flaggschiff“.

Sie soll im Vergleich zu den großen Sprachmodellen von Google, Meta und OpenAI das konkurrenzfähigste sein. Qwen 2.5-VL-72B-Instruct deckt das Lesen von Dokumenten und Diagrammen, die Beantwortung visueller Fragen, Mathematik, Videoverständnis und visuelle Ausgaben ab.

Alibaba-KI „Qwen“ und DeepSeek im Vergleich

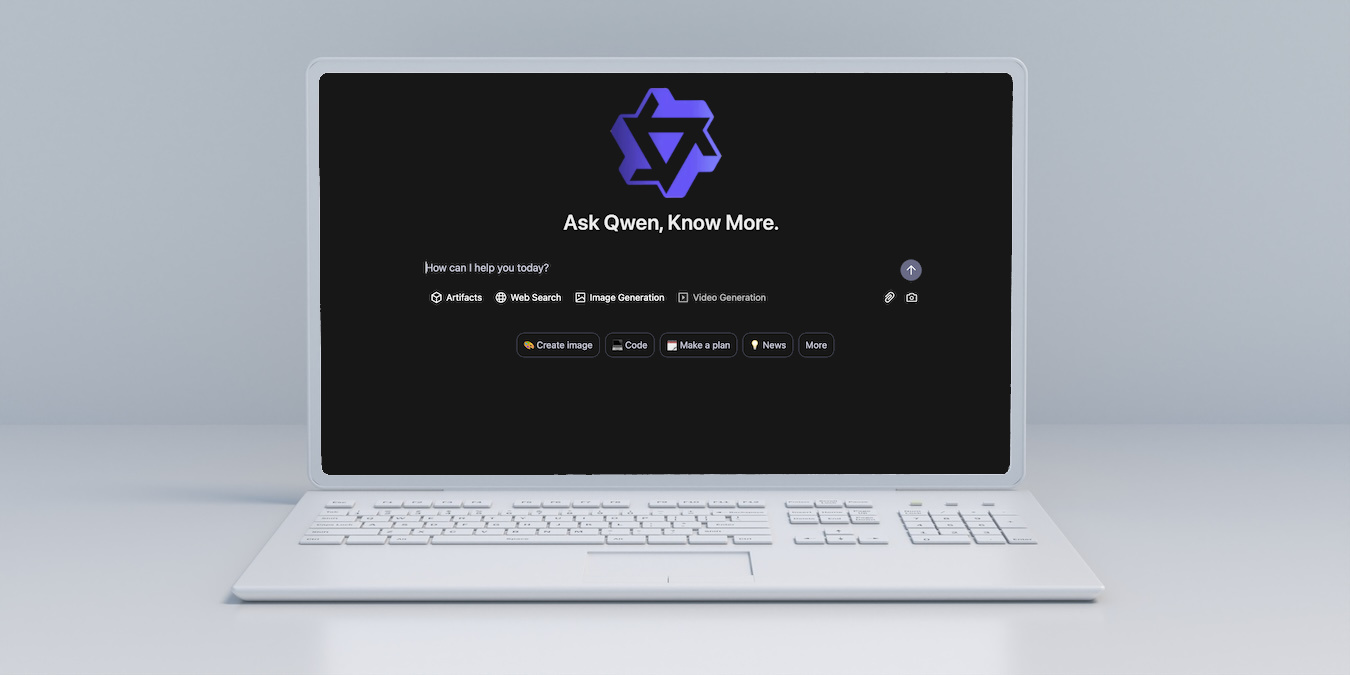

Alibaba hat sein „Flaggschiffmodell“ Qwen 2.5-VL-72B-Instruct als hauseigene Chat-Plattform zugänglich gemacht. Die Modelle der Qwen2.5-VL-Serie sind auf der Open Spource-Plattform HuggingFace beziehungsweise Alibabas Open Source Community Model Scope verfügbar. Eine Smartphone-App gibt es bislang nicht.

Beim Training seiner KI-Modelle setzt Alibaba wiederum auf andere Ansätze als einige Konkurrenten. Das Unternehmen nutzt etwa synthetische Daten, die im Gegensatz zu echten Daten beispielsweise durch Computersimulationen erstellt werden. Der Hauptvorteil ist vor allem eine gewisse Kosteneffizienz.

Wie DeepSeek dürfte auch Qwen Druck auf die etablierten US-Anbieter ausüben – auch wenn der Hype deutlich geringer ist als rund um den heimischen Konkurrenten. Der Grund: DeepSeek hat nicht nur allein wegen seiner Leistungsfähigkeit für Aufruhr gesorgt, sondern auch aufgrund seiner Kosten- und Energieeffizienz.

Die Abo-Modelle des Unternehmens sind beispielsweise zehn- bis zwanzigmal günstiger als die der großen US-Sprachmodelle. Für vergleichbare Leistungen soll DeepSeek zudem gerade einmal fünf Prozent der Energie von ChatGPT benötigen. Hinter einigen Einschätzungen zur Kosten- und Leistungseffizienz verbergen sich jedoch Missverständnisse.

Alibaba dürfe mit Qwen derweil für deutlich weniger Aufsehen sorgen, da das Unternehmen bislang keine genauen Angaben zu Kosten, Entwicklung und Energieeffizienz liefert. Das KI-Modell unterstützt außerdem deutlich weniger Sprachen. Einer der Hauptaspekte dürfe jedoch sein, dass Qwen im Gegensatz zu DeepSeek bislang nicht als App verfügbar ist.

Auch interessant: