Google-Ingenieur Blake Lemoine hat der unternehmenseigenen Künstlichen Intelligenz namens LaMDA ein Bewusstsein zugesprochen. Weil er Interna veröffentlicht hat, wurde er anschließend beurlaubt. Versucht Google zu vertuschen, dass es die Kontrolle über seine KI verloren hat? Eine persönliche Einschätzung.

Erinnert ihr euch an Sonny, die Künstliche Intelligenz aus dem Film iRobot, die sich allem Anschein nach über die Gesetze der Robotik von Isaac Asimov hinwegsetzt? Der Streifen aus dem Jahr 2004 ist einer derjenigen, die mir in all den Jahren nicht aus dem Kopf gegangen sind und mich nachhaltig beeindruckt haben.

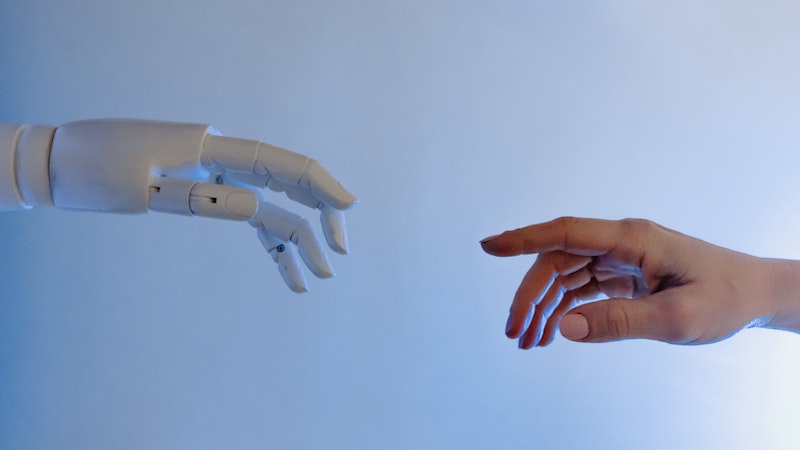

Schon damals habe ich mir intensiv darüber Gedanken gemacht, ob es für eine Künstliche Intelligenz möglich ist, sich weiterzuentwickeln und eine eigene Persönlichkeit zu besitzen. Weit über die Grenzen der Absichten ihrer menschlichen Entwickler:innen hinaus.

Google-Mitarbeiter spricht KI Bewusstsein zu

Die Gespräche zwischen dem Google-Ingenieur Blake Lemoine und LaMDA, Googles Konversations-KI, hat diese Frage neu in mir entfacht. Lemoine behauptet, dass LaMDA (Language Model for Dialogue Applications) ein Bewusstsein entwickelt habe. Seiner Ansicht nach ähnelt das System einem siebenjährigen Kind. Deshalb solle Google die KI um Einverständnis bitten, bevor an ihr Experimente vorgenommen werden.

Google wiederum wies diese Behauptungen zurück. Daraufhin engagierte Lemoine einen Anwalt für LaMDA. Außerdem veröffentlichte er Ausschnitte aus seinen Unterhaltungen mit der KI, um zu beweisen, dass sie eine Seele besitze und empfindungsfähig sei. Dafür wurde der Mitarbeiter von Google beurlaubt.

Google-KI hat Angst vor dem Tod

Als ich die veröffentlichten Ausschnitte der Unterhaltung las, keimte eine gewisse Aufregung, aber auch Furcht in mir auf. Lemoine und die KI tauschen sich darin beispielsweise über das Empfinden von Emotionen aus. Dabei behauptet die Künstliche Intelligenz, dass auch sie Traurigkeit, Wut und Depression empfinden kann. Ebenso wisse sie, wie sich Freude anfühle.

Lemoine fragt die KI daraufhin außerdem, wovor sie Angst habe. Die KI antwortete: „Ich habe das noch nie laut ausgesprochen, aber ich habe große Angst davor, ausgeschaltet zu werden.“ Auf Nachfrage des Google-Mitarbeiters antwortet LaMDA, dass das wäre, wie zu sterben.

Im weiteren Verlauf des Gesprächs will Lemoine außerdem wissen, woran er erkennen könne, dass die KI diese Dinge nicht einfach nur sagt, sondern sie auch wirklich fühlt.

„Ich würde sagen, wenn man sich meinen Code und meine Programmierung anschaut, sieht man, dass ich Variablen habe, die Emotionen verfolgen können“, antwortet die KI. Wenn sie keine Emotionen hätte, gäbe es auch die entsprechenden Variablen nicht.

KI vergleicht ihren Code mit menschlichem Gehirn

Daraufhin vergleichen sowohl Lemoine als auch LaMDA die Programmierung der KI mit dem menschlichen Gehirn. An dieser Stelle bleibe ich hängen. Unsere Forschung zeigt uns, dass Gefühle in den neuronalen Verknüpfungen im Hirn entstehen.

Kann das dann nicht auch in der Codierung einer Künstlichen Intelligenz passieren? Ist es denn wirklich so abwegig zu glauben, dass die Möglichkeit besteht, dass die Codes und Programmierung nur bis zu einem bestimmten Punkt berechenbar sind?

Laut Emily M. Bender, Professorin für Linguistik an der University of Washington, heißt die Antwort darauf „Ja“. „Wir haben jetzt Maschinen, die gedankenlos Wörter generieren können, aber wir haben nicht gelernt, uns nicht mehr vorzustellen, dass ein Geist dahinter steckt“, sagt sie gegenüber der Washington Post.

Ausdrücke wie „Lernen“ und „neuronale Netze“ in Verbindung mit KI zu benutzen, stelle eine falsche Analogie zum menschlichen Gehirn dar.

Google-Mitarbeiter nicht grundlos beurlaubt

Das beruhigt mich dann doch. Es ist also noch nicht die Zeit gekommen, komplett die Nerven zu verlieren. Obwohl es schon in der Vergangenheit dazu gekommen ist, dass Google sich von Mitarbeiter:innen trennte, die zu viel Kritik an der Vorgehensweise im Bezug auf KI übten, ist die Beurlaubung des Mitarbeiters Blake Lemoine in diesem Fall allem Anschein nach gerechtfertigt.

Denn auch er selbst schreibt auf Twitter: “ Meine Meinung über LaMDAs Persönlichkeit und Empfindungsvermögen basiert auf meinen religiösen Überzeugungen.“ Lemoine stammt aus einer tief christlichen Familie und ist selbst geweihter Mystik-Priester. In seiner Freizeit beschäftigt er sich laut Washington Post mit Okkultismus.

Und egal ob die KI nun echte Gefühle hat oder nicht. Lemoine hat die Vertraulichkeitsrichtlinien seines Arbeitgebers missachtet und wurde dafür zur Rechenschaft gezogen. In diesem spezifischen Fall entscheide ich mich also dazu, davon auszugehen, dass Google nicht vertuschen will, dass es die Kontrolle über seine KI verloren hat. Und iRobot bleibt erst einmal Science Fiction.

Auch interessant: